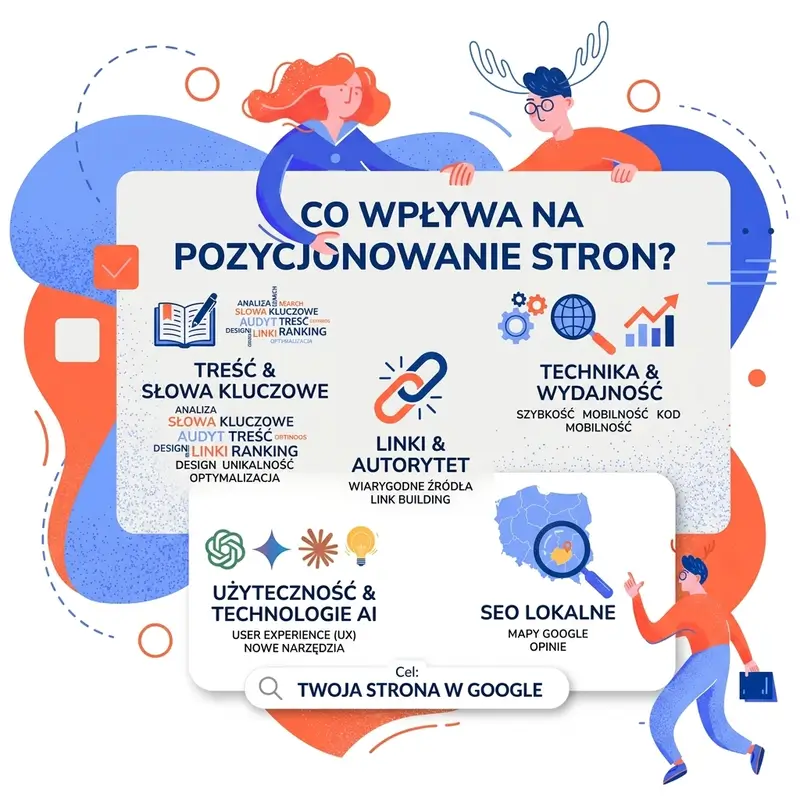

Zrozumienie technicznych fundamentów działania witryny internetowej stanowi absolutną podstawę w procesie budowania widoczności w wyszukiwarkach, ponieważ to właśnie technologia determinuje, czy roboty indeksujące będą w stanie poprawnie odczytać zawartość serwisu. Kiedy zastanawiamy się nad tym, co wpływa na pozycjonowanie stron w Google, musimy w pierwszej kolejności spojrzeć na architekturę informacji oraz dostępność kodu dla algorytmów, które nieustannie przeczesują sieć w poszukiwaniu nowych danych. Prawidłowa indeksacja jest pierwszym krokiem do sukcesu, a wszelkie błędy w pliku robots.txt lub niewłaściwe użycie meta tagów mogą całkowicie wykluczyć witrynę z wyników wyszukiwania, niezależnie od jakości zamieszczonych na niej treści. Kluczowym elementem jest tutaj optymalizacja pod kątem crawl budgetu, czyli zasobów, jakie Google przeznacza na odwiedzanie danej domeny, co jest szczególnie istotne w przypadku dużych sklepów internetowych posiadających tysiące podstron produktowych. Struktura adresów URL powinna być czytelna zarówno dla użytkowników, jak i dla botów, co oznacza unikanie ciągów niezrozumiałych znaków na rzecz logicznych ścieżek zawierających słowa kluczowe opisujące zawartość danej sekcji. Ponadto, niebagatelne znaczenie ma implementacja mapy witryny w formacie XML, która służy jako drogowskaz dla robotów Google, wskazując im wszystkie istotne podstrony, które powinny znaleźć się w indeksie, a także informując o dacie ich ostatniej modyfikacji. Warto również wspomnieć o obsłudze błędów na stronie, ponieważ duża liczba stron zwracających błąd 404 może być sygnałem dla algorytmu, że witryna jest zaniedbana i nieaktualizowana, co negatywnie odbija się na jej ogólnej ocenie. Przekierowania, zwłaszcza te typu 301, muszą być wdrażane z rozwagą, aby nie tworzyć pętli przekierowań, które nie tylko irytują użytkowników, ale także marnują zasoby robotów indeksujących i utrudniają właściwą interpretację struktury serwisu. Dbałość o czystość kodu HTML, semantyczne znaczniki oraz eliminacja zbędnych skryptów JavaScript, które mogą blokować renderowanie zawartości, to kolejne cegiełki budujące solidny fundament techniczny, bez którego nawet najlepsza strategia marketingowa nie przyniesie oczekiwanych rezultatów w organicznych wynikach wyszukiwania.

Dlaczego unikalne treści decydują o tym co wpływa na pozycjonowanie

W świecie marketingu internetowego od lat panuje przekonanie, że zawartość jest królem, i to stwierdzenie pozostaje w pełni aktualne, gdy analizujemy czynniki determinujące wysoką pozycję w rankingu wyszukiwarki. Wysokiej jakości, merytoryczne i co najważniejsze unikalne teksty są paliwem dla algorytmów, które starają się dostarczyć użytkownikom najbardziej trafne odpowiedzi na zadawane przez nich pytania. Kopiowanie treści z innych źródeł, znane jako duplicate content, jest surowo karane przez Google, co może skutkować obniżeniem pozycji w rankingu lub nawet całkowitym usunięciem strony z indeksu, dlatego inwestycja w oryginalny copywriting jest niezbędna. Algorytmy stają się coraz bardziej zaawansowane w rozumieniu kontekstu i intencji użytkownika, co sprawia, że proste nasycenie tekstu słowami kluczowymi już nie wystarcza, a wręcz może być szkodliwe i odebrane jako spam. Współczesne SEO wymaga tworzenia treści, które wyczerpują temat, odpowiadają na konkretne problemy odbiorców i są napisane językiem naturalnym, zrozumiałym dla człowieka, a nie tylko dla maszyny. Istotnym aspektem jest tutaj koncepcja E-E-A-T, czyli doświadczenie, ekspertyza, autorytet i zaufanie, którą Google promuje jako wyznacznik jakości, szczególnie w branżach mających wpływ na zdrowie lub finanse użytkowników. Oznacza to, że artykuły powinny być tworzone przez ekspertów w danej dziedzinie, a informacje w nich zawarte muszą być rzetelne i weryfikowalne, co buduje zaufanie zarówno czytelników, jak i samej wyszukiwarki. Długość treści również ma znaczenie, choć nie jest jedynym wyznacznikiem, ponieważ dłuższe formy zazwyczaj pozwalają na głębsze przeanalizowanie tematu, co zwiększa szansę na pokrycie szerokiego spektrum zapytań powiązanych z głównym słowem kluczowym. Regularność publikacji nowych materiałów jest kolejnym sygnałem dla Google, że strona żyje i dostarcza świeżych informacji, co zachęca roboty do częstszych odwiedzin i szybszego indeksowania nowych podstron. Zróżnicowanie formy przekazu poprzez dodawanie grafik, materiałów wideo czy infografik nie tylko uatrakcyjnia przekaz dla odbiorcy, wydłużając czas spędzony na stronie, ale także daje dodatkowe możliwości optymalizacji pod kątem wyszukiwania obrazem czy wideo. Ostatecznie to właśnie wartość merytoryczna i unikalność tekstów sprawiają, że użytkownicy chętniej linkują do danej strony i dzielą się nią w mediach społecznościowych, co pośrednio wzmacnia jej autorytet w oczach Google.

W jaki sposób profil linków zwrotnych kształtuje pozycjonowanie stron w Google

Linki zwrotne, czyli odnośniki prowadzące z innych witryn do naszej strony, od samego początku istnienia Google stanowiły jeden z najważniejszych filarów algorytmu i nadal odgrywają fundamentalną rolę w procesie rankowania. Traktowane są one przez wyszukiwarkę jako głosy poparcia, swoiste rekomendacje, które świadczą o tym, że dana witryna jest wartościowa, godna zaufania i zawiera treści, na które warto powoływać się w innych publikacjach. Jednakże w dzisiejszych czasach nie liczy się już tylko sama ilość pozyskanych linków, ale przede wszystkim ich jakość oraz profil źródła, z którego pochodzą. Jeden link z renomowanego portalu branżowego, uniwersytetu czy strony rządowej może mieć znacznie większą moc pozycjonującą niż tysiące odnośników z farm linków czy niskiej jakości katalogów, które mogą wręcz zaszkodzić domenie. Algorytm Pingwin, wprowadzony przez Google lata temu, skutecznie walczy z nienaturalnym profilowaniem linków, karząc strony, które próbują manipulować rankingiem poprzez masowe kupowanie odnośników lub udział w systemach wymiany linków. Dlatego też strategia link buildingu musi opierać się na naturalnym przyroście odnośników, wynikającym z wysokiej jakości publikowanych treści, które inni twórcy chcą cytować dobrowolnie. Istotnym elementem jest również różnorodność źródeł linkowania, ponieważ pozyskiwanie odnośników wyłącznie z jednego typu stron lub z jednej lokalizacji geograficznej może wyglądać podejrzanie dla algorytmów Google. Tekst kotwicy, czyli anchor text, również ma znaczenie, ale jego nadmierna optymalizacja poprzez ciągłe używanie słów kluczowych w dopasowaniu ścisłym jest ryzykowna i może zostać odebrana jako próba manipulacji, dlatego zaleca się stosowanie zróżnicowanych kotwic, w tym nazwy marki czy naturalnych zwrotów. Linki wewnętrzne, choć często pomijane, również pełnią ważną funkcję, pomagając robotom zrozumieć hierarchię strony i przekazując moc SEO pomiędzy poszczególnymi podstronami, co pozwala wzmocnić słabsze sekcje serwisu. Warto również monitorować profil linków przychodzących i w razie wykrycia toksycznych odnośników, które mogłyby zaszkodzić reputacji witryny, korzystać z narzędzia Disavow Tool, aby zrzec się powiązań z niechcianymi stronami. Budowanie autorytetu domeny poprzez link building to proces długofalowy i wymagający cierpliwości, ale bez solidnego zaplecza w postaci wartościowych odnośników trudno jest rywalizować o czołowe pozycje na konkurencyjne frazy.

Czy szybkość ładowania witryny realnie wpływa na pozycjonowanie w Google

W dobie powszechnego dostępu do szybkiego internetu i rosnącej niecierpliwości użytkowników, wydajność strony stała się jednym z kluczowych czynników technicznych, które Google bierze pod uwagę przy ustalaniu rankingu. Szybkość ładowania witryny nie jest już tylko kwestią wygody użytkownika, ale oficjalnym sygnałem rankingowym, co zostało potwierdzone wprowadzeniem wskaźników Core Web Vitals, które precyzyjnie mierzą doświadczenia internautów związane z wydajnością. Wolno ładująca się strona nie tylko frustruje odwiedzających, zwiększając współczynnik odrzuceń, ale także marnuje zasoby robotów indeksujących, które mogą nie zdążyć zaindeksować wszystkich podstron przed upływem limitu czasu przeznaczonego na daną sesję. Google dąży do promowania serwisów, które dostarczają treści błyskawicznie, dlatego optymalizacja czasu reakcji serwera oraz minimalizacja rozmiaru przesyłanych danych stają się priorytetem dla każdego webmastera i specjalisty SEO. Elementem, który najczęściej spowalnia działanie stron, są niezoptymalizowane grafiki o zbyt dużej rozdzielczości i wadze, dlatego ich kompresja oraz stosowanie nowoczesnych formatów takich jak WebP jest absolutną koniecznością. Równie istotne jest ograniczenie liczby zapytań HTTP generowanych przez stronę, co można osiągnąć poprzez łączenie plików CSS i JavaScript oraz korzystanie z pamięci podręcznej przeglądarki, co pozwala na szybsze wczytanie witryny przy ponownych odwiedzinach. Wskaźnik LCP, czyli Largest Contentful Paint, mierzy czas potrzebny na wyrenderowanie największego elementu widocznego na ekranie i jest jednym z najważniejszych parametrów ocenianych przez Google w kontekście Core Web Vitals. Z kolei opóźnienie przy pierwszym wprowadzaniu danych, znane jako FID, a zastępowane przez INP, odnosi się do interaktywności strony i czasu, jaki upływa od momentu kliknięcia przez użytkownika do reakcji przeglądarki. Stabilność wizualna, mierzona wskaźnikiem CLS, również wpływa na ocenę strony, karząc witryny, na których elementy przesuwają się w trakcie ładowania, co może prowadzić do przypadkowych kliknięć i negatywnych doświadczeń. Wykorzystanie sieci dostarczania treści, czyli CDN, pozwala na fizyczne przybliżenie zasobów strony do użytkownika, co znacząco skraca czas ładowania, zwłaszcza w przypadku witryn o zasięgu globalnym. Inwestycja w szybki hosting i optymalizację kodu to działania, które przekładają się bezpośrednio na lepsze pozycje w wynikach wyszukiwania, ponieważ Google chce kierować swoich użytkowników tylko do takich miejsc w sieci, które działają sprawnie i bezproblemowo.

Jak dostosowanie do urządzeń mobilnych zmienia to co wpływa na pozycjonowanie

Rewolucja mobilna całkowicie zmieniła krajobraz internetu, a Google, podążając za trendami i zachowaniami użytkowników, wprowadziło paradygmat Mobile-First Indexing, co oznacza, że to wersja mobilna strony jest teraz tą główną, braną pod uwagę przy indeksowaniu i ocenianiu witryny. Brak responsywności lub posiadanie oddzielnej, okrojonej wersji mobilnej może drastycznie obniżyć widoczność serwisu, nawet jeśli jego wersja desktopowa jest perfekcyjnie dopracowana. Współczesne strony muszą być projektowane w technologii RWD, czyli Responsive Web Design, która sprawia, że witryna automatycznie dostosowuje swój układ i rozmiar elementów do wielkości ekranu, na którym jest wyświetlana, zapewniając czytelność i łatwość nawigacji na każdym urządzeniu. Google w swoich narzędziach, takich jak Google Search Console, udostępnia raporty dotyczące obsługi na urządzeniach mobilnych, wskazując błędy takie jak zbyt mała czcionka, elementy klikalne umieszczone zbyt blisko siebie czy treść szersza niż ekran. Użytkownicy korzystający ze smartfonów często szukają informacji w biegu, dlatego kluczowe jest, aby strona na urządzeniach przenośnych ładowała się błyskawicznie i umożliwiała szybkie dotarcie do poszukiwanych treści bez konieczności powiększania ekranu czy przewijania w poziomie. Ponadto, interfejs dotykowy wymaga innego podejścia do projektowania menu i przycisków, które muszą być odpowiednio duże i łatwo dostępne kciukiem, co bezpośrednio wpływa na doświadczenia użytkownika i jego ocenę strony. Warto również pamiętać, że na urządzeniach mobilnych mniej miejsca jest na ekranie, co wymusza hierarchizację treści i prezentowanie najważniejszych informacji „above the fold”, czyli w obszarze widocznym bez przewijania. Wyszukiwania lokalne są ściśle powiązane z urządzeniami mobilnymi, ponieważ użytkownicy często szukają usług czy sklepów w swojej najbliższej okolicy, co sprawia, że optymalizacja pod kątem local SEO staje się integralną częścią strategii mobilnej. Ignorowanie użytkowników mobilnych to odcinanie się od ponad połowy ruchu w internecie, co Google surowo karze niższymi pozycjami, promując w zamian te serwisy, które są przyjazne dla smartfonów i tabletów. Testowanie strony na różnych rozdzielczościach i systemach operacyjnych jest niezbędne, aby upewnić się, że każdy użytkownik, niezależnie od posiadanego sprzętu, otrzyma spójne i pozytywne doświadczenie. Dostosowanie mobilne nie jest już opcją, ale fundamentalnym wymogiem, który decyduje o być albo nie być w nowoczesnym internecie zdominowanym przez urządzenia przenośne.

Rola doświadczeń użytkownika w procesie wpływającym na pozycjonowanie stron w Google

Choć Google oficjalnie nie zawsze potwierdza bezpośredni wpływ wszystkich wskaźników behawioralnych na ranking, to w praktyce zadowolenie użytkownika jest nadrzędnym celem wyszukiwarki, a sygnały płynące z zachowania internautów są nieocenionym źródłem informacji o jakości strony. User Experience, czyli ogół wrażeń, jakich doświadcza użytkownik podczas korzystania z witryny, stał się jednym z kluczowych obszarów zainteresowania specjalistów SEO, którzy rozumieją, że techniczna doskonałość i świetne treści na nic się nie zdadzą, jeśli strona będzie nieużyteczna. Wysoki współczynnik odrzuceń może sugerować, że strona nie odpowiada na zapytanie wpisane w wyszukiwarkę lub jest nieatrakcyjna wizualnie, co może być sygnałem dla algorytmu, że dany wynik nie powinien znajdować się wysoko w rankingu. Czas przebywania na stronie, czyli Dwell Time, to kolejny wskaźnik, który może być interpretowany jako miara zaangażowania – im dłużej użytkownik zapoznaje się z treścią, tym bardziej prawdopodobne, że znalazł to, czego szukał. Zjawisko pogo-sticking, polegające na szybkim powrocie do wyników wyszukiwania po kliknięciu w link i wybraniu innej strony, jest dla Google wyraźnym sygnałem, że pierwsza odwiedzona witryna nie spełniła oczekiwań użytkownika, co może skutkować jej spadkiem w wynikach na daną frazę. Czytelna nawigacja, intuicyjna struktura menu oraz brak agresywnych reklam typu pop-up, które zasłaniają treść, to elementy budujące pozytywne doświadczenia i zachęcające do głębszej eksploracji serwisu. Dostępność cyfrowa dla osób z niepełnosprawnościami również staje się coraz ważniejsza, a strony dostosowane do standardów WCAG są lepiej postrzegane nie tylko przez użytkowników, ale i przez roboty indeksujące, które dzięki temu lepiej rozumieją strukturę i zawartość witryny. Estetyka strony, dobór kolorów i typografia mają wpływ na to, jak użytkownik postrzega wiarygodność marki, a zaufanie jest kluczowym elementem w budowaniu autorytetu domeny. Google coraz mocniej stawia na sygnały związane z użytecznością, co widać chociażby we wspomnianych wcześniej wskaźnikach Core Web Vitals, które są stricte technicznym odzwierciedleniem jakości doświadczeń użytkownika. Optymalizacja UX i SEO to obecnie naczynia połączone, a granica między tymi dziedzinami zaciera się, tworząc nową jakość, w której centrum znajduje się człowiek i jego potrzeby. Tworzenie stron, które są przyjemne w obsłudze, logiczne i pomocne, jest najlepszą strategią na zdobycie przychylności zarówno użytkowników, jak i algorytmów Google.

Znaczenie precyzyjnego doboru słów kluczowych dla tego co wpływa na pozycjonowanie

Słowa kluczowe od zawsze stanowiły fundament komunikacji między użytkownikiem a wyszukiwarką, definiując temat zapytania i pozwalając algorytmom na dopasowanie najbardziej adekwatnych treści. Jednak sposób, w jaki wykorzystujemy frazy kluczowe w procesie optymalizacji, ewoluował z prostego upychania słów w tekście w stronę analizy semantycznej i zrozumienia intencji kryjących się za danym zapytaniem. Obecnie kluczowe jest nie tylko umieszczenie głównej frazy w tytule strony, nagłówkach H1-H6 czy w treści akapitów, ale przede wszystkim zbudowanie kontekstu, który pozwoli Google w pełni zrozumieć tematykę podstrony. Badanie słów kluczowych powinno obejmować nie tylko najpopularniejsze, ogólne frazy, które są zazwyczaj bardzo konkurencyjne, ale także te z tak zwanego długiego ogona, czyli long-tail, które są bardziej precyzyjne, generują mniejszy ruch, ale za to charakteryzują się znacznie wyższym współczynnikiem konwersji. Ważne jest, aby treści na stronie zawierały nie tylko główne słowo kluczowe, ale także wyrazy bliskoznaczne, synonimy oraz frazy powiązane tematycznie, co jest zgodne z ideą LSI (Latent Semantic Indexing), pomagającą robotom w kategoryzacji treści. Optymalizacja metadanych, takich jak title tag i meta description, choć nie ma bezpośredniego wpływu na ranking w przypadku tego drugiego, jest kluczowa dla współczynnika klikalności (CTR), ponieważ to właśnie te elementy widzi użytkownik w wynikach wyszukiwania i na ich podstawie decyduje, czy odwiedzić daną stronę. Nadmierne nasycenie tekstu słowami kluczowymi, znane jako keyword stuffing, jest techniką przestarzałą i szkodliwą, która sprawia, że tekst staje się nieczytelny dla człowieka i może zostać zakwalifikowany przez Google jako spam. Zamiast tego należy skupić się na naturalnym wpleceniu fraz w narrację, tak aby stanowiły integralną część wartościowej treści, a nie sztuczny dodatek. Należy również pamiętać o kanibalizacji słów kluczowych, czyli sytuacji, w której wiele podstron w obrębie jednej domeny jest zoptymalizowanych pod te same frazy, co sprawia, że konkurują one ze sobą w wynikach wyszukiwania, osłabiając ogólną widoczność serwisu. Analiza konkurencji i monitorowanie pozycji na wybrane frazy pozwala na bieżąco korygować strategię i dostosowywać ją do zmieniających się trendów oraz zachowań użytkowników. Dobór słów kluczowych to proces ciągły, wymagający zrozumienia języka odbiorców i umiejętnego przełożenia go na strukturę i treść witryny internetowej.

Bezpieczeństwo witryny i certyfikaty SSL jako czynniki wpływające na pozycjonowanie w Google

W obliczu rosnącej liczby zagrożeń w cyberprzestrzeni, bezpieczeństwo użytkowników stało się priorytetem dla Google, co znajduje bezpośrednie odzwierciedlenie w czynnikach rankingowych. Protokół HTTPS, który zapewnia szyfrowane połączenie między przeglądarką użytkownika a serwerem, jest już od kilku lat oficjalnym sygnałem rankingowym, a brak certyfikatu SSL skutkuje oznaczaniem strony jako „niebezpiecznej” w przeglądarce Chrome, co drastycznie obniża zaufanie odwiedzających. Dla sklepów internetowych i stron przetwarzających dane osobowe szyfrowanie jest absolutnym wymogiem, ale nawet w przypadku prostych blogów czy wizytówek firmowych wdrożenie HTTPS jest standardem, którego nie można ignorować. Google chce promować bezpieczny internet, dlatego strony, które nie dbają o bezpieczeństwo swoich użytkowników, mają trudniej w walce o czołowe pozycje. Poza samym certyfikatem SSL, istotne jest również zabezpieczenie witryny przed atakami hakerskimi i złośliwym oprogramowaniem, ponieważ zainfekowana strona może zostać natychmiastowo usunięta z indeksu, aby chronić internautów przed zagrożeniem. Regularne aktualizacje systemu CMS, wtyczek oraz skryptów są kluczowe dla załatania luk bezpieczeństwa, które mogłyby zostać wykorzystane przez cyberprzestępców do przejęcia kontroli nad serwisem lub wstrzyknięcia spamu. Monitorowanie w Google Search Console raportów dotyczących bezpieczeństwa pozwala na szybką reakcję w przypadku wykrycia problemów, co minimalizuje ryzyko długotrwałej utraty widoczności. Bezpieczeństwo strony to także ochrona przed atakami DDoS, które mogą doprowadzić do niedostępności serwisu, co z kolei negatywnie wpływa na jego ocenę przez roboty Google, które nie mogą zaindeksować treści. Zaufanie jest walutą w internecie, a dbałość o techniczne aspekty bezpieczeństwa jest fundamentem budowania wiarygodności marki w oczach zarówno klientów, jak i wyszukiwarki. Wdrożenie protokołu HSTS, który wymusza na przeglądarce korzystanie wyłącznie z bezpiecznych połączeń, jest kolejnym krokiem w stronę podniesienia poziomu bezpieczeństwa i sygnałem dla Google o profesjonalnym podejściu administratora. Warto pamiętać, że użytkownicy są coraz bardziej świadomi zagrożeń i widok kłódki przy adresie strony jest dla nich potwierdzeniem, że znajdują się w bezpiecznym miejscu, co sprzyja dłuższemu przebywaniu na witrynie i dokonywaniu konwersji.

Aktualizacje algorytmów wyszukiwarki i ich bezpośredni wpływ na pozycjonowanie stron

Środowisko SEO jest dynamiczne i nieustannie się zmienia, co jest bezpośrednim skutkiem regularnych aktualizacji algorytmu wyszukiwarki Google, które mają na celu udoskonalenie jakości wyników wyszukiwania i eliminację spamu. Zrozumienie historii i natury tych zmian jest kluczowe dla każdego, kto chce utrzymać wysoką widoczność w sieci, ponieważ to, co działało rok temu, dzisiaj może być nieskuteczne lub wręcz szkodliwe. Główne aktualizacje, takie jak Panda, która skupiała się na jakości treści, czy Pingwin, walczący z nienaturalnymi linkami, na zawsze zmieniły sposób, w jaki pozycjonuje się strony, wymuszając odejście od technik manipulacyjnych na rzecz budowania realnej wartości. Wprowadzenie algorytmu Koliber, a później RankBrain i BERT, pozwoliło Google na znacznie lepsze rozumienie języka naturalnego, kontekstu i intencji użytkownika, co sprawiło, że SEO przesunęło się w stronę optymalizacji tematycznej, a nie tylko opartej na słowach kluczowych. Core Updates, czyli główne aktualizacje algorytmu wypuszczane kilka razy w roku, często powodują duże przetasowania w wynikach wyszukiwania, premiując strony o wysokim autorytecie i jakości, a obniżając pozycje tych, które nie spełniają rosnących standardów. Śledzenie komunikatów Google oraz branżowych portali jest niezbędne, aby na bieżąco reagować na zmiany i dostosowywać strategię do nowych wytycznych, takich jak chociażby nacisk na Helpful Content, czyli treści tworzone z myślą o ludziach, a nie pod roboty. Algorytmy coraz lepiej radzą sobie z oceną wiarygodności informacji, co jest szczególnie widoczne w przypadku stron YMYL (Your Money Your Life), gdzie wymagania dotyczące rzetelności są znacznie wyższe. Spam Update to kolejna broń w arsenale Google, wymierzona w strony stosujące techniki cloakingu, generowania treści przez automaty niskiej jakości czy inne formy oszustwa. Zrozumienie, że Google nieustannie dąży do dostarczania najlepszych możliwych odpowiedzi, pozwala przyjąć odpowiednią postawę – zamiast szukać luk w algorytmze, należy skupić się na budowaniu strony, która będzie najlepszym wynikiem dla danego zapytania. Stabilna strategia SEO musi być elastyczna i odporna na wahania algorytmiczne, co osiąga się poprzez dywersyfikację źródeł ruchu i dbałość o najwyższą jakość we wszystkich obszarach działania witryny. Ciągła edukacja i analiza zmian w wynikach wyszukiwania to jedyny sposób, aby nie zostać w tyle i skutecznie rywalizować o uwagę użytkowników w coraz bardziej zatłoczonym cyfrowym świecie.